Desde hace unos meses, con motivo de la llegada al mercado del iPad Pro, se acuñó un término que se ha ido popularizando cada vez que se mencionan temas relacionados con mejoras fotográficas, y el LiDAR es aquélla sigla que ofrece un sinnúmero de opciones que hasta ahora es un potencial que algunos están tomándole sentido.

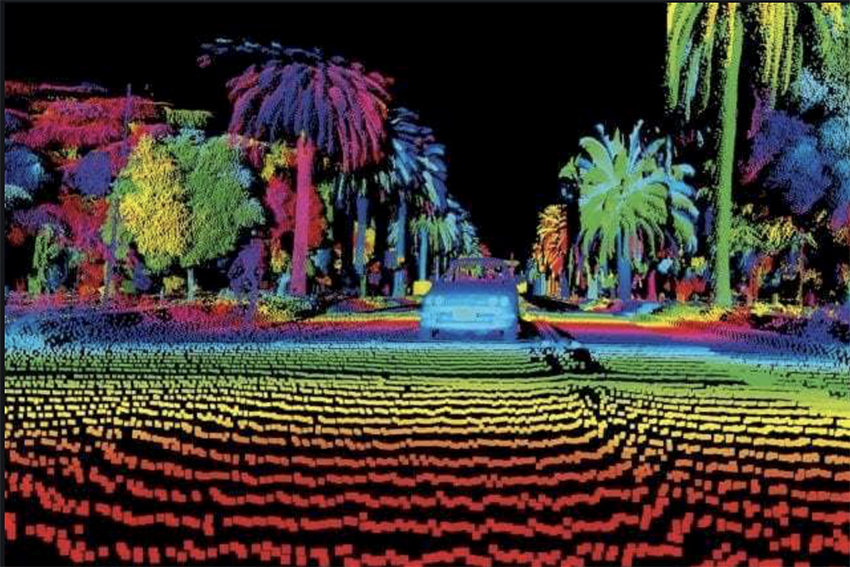

Para entenderlo en simple, la definición del acrónimo LiDAR es un dispositivo que permite determinar la distancia desde un emisor láser a un objeto o superficie utilizando un haz láser pulsado, la distancia al objeto se determina midiendo el tiempo de retraso entre la emisión del pulso y su detección a través de la señal reflejada. La sigla en inglés es (Light Detection and Ranging o Laser Imaging Detection and Ranging)

LiDAR, el sensor trasero podría ser una vista previa de la tecnología que se abre paso en los próximos iPhones, lo que significa que las primeras aplicaciones de iPad Pro podrían ofrecer una ventana hacia el territorio en el que Apple se aventura a continuación, como si fuese un «ensayo» y aprovechar de motivar a los creativos.

Apple probablemente pondrá un gran énfasis en las nuevas herramientas de AR en la próxima WWDC que parte el lunes y al menos hay un avance previo que poder conocer, y es la nueva aplicación de escaneo doméstico de Occipital, Canvas, que puede ser el indicador más claro de lo que vendrá para una próxima generación de apps basadas en profundidad.

Occipital es una compañía que ha fabricado hardware y software para cámaras con detección de profundidad durante años, similar al tipo de tecnología que solía estar en las primeras tablets y ahora extintos teléfonos Tango de Google cuya cámara de estructura podría medir la profundidad en una habitación, combinada con la captura de imágenes, y construir una malla de un espacio mapeado en 3D.

En los años posteriores, compañías como 6D.ai, ahora en manos de Niantic de Pokemon Go, han descubierto formas de medir y mapear el espacio sin ningún hardware adicional de detección de profundidad. Desde entonces, Occipital se ha movido a un enfoque basado en software para sus herramientas de escaneo.

La última aplicación Canvas de Occipital utiliza cámaras normales de iPhone y iPad para engranar y mapear habitaciones rápidamente, pero la compañía también está agregando soporte para el sensor LiDAR del iPad Pro debido a su rango adicional de detección de profundidad y es probable que pocos desarrolladores hayan señalado los distintos sensores de profundidad LiDAR del iPad Pro porque los modelos iPad Pro 2020 son un subconjunto relativamente pequeño de todos los dispositivos listos para AR de Apple.

A medida que esa tecnología de detección de profundidad se expanda a través de la línea hacia teléfonos y otros iPads, es probable que lo que Occipital esté buscando también ocurra con otras compañías.

El LiDAR del iPad Pro no es una cámara sino un sensor separado sin cámara, y los mapas de profundidad que recoge son más como conjuntos de puntos en el espacio, formando una malla o un mapeo 3D y la aplicación de Occipital también puede usar los datos de la cámara para estirar las fotos en una malla 3D simulada, pero los procesos están separados, pero las futuras cámaras AR podrían combinar ambas funciones más.

Es probable que Apple anuncie más cambios importantes en sus herramientas AR la próxima semana en su conferencia remota de desarrolladores de WWDC, pero hacer más de las funciones del sensor lidar y cómo se relaciona con los datos de la cámara podría ser el siguiente paso para los iPhones.